(1)目前最强的内容生成能力;

(2)目前最强的个性化能力;

【资料图】

【资料图】

(3)目前最强的上下文关联能力;

(4)最独特的“喂饭”机制;

(5)免魔法上网,免费;

画外音,详细内容参考:

《最好用的AI工具居然是它!》

《最强提示词技巧"喂饭机制",没有之一!》

AI确实有很多优点,但AI也有诸多不足,在使用过程中要万分注意。

【1】尽量不要问AI工具关于它自己的问题

用提示词和AI沟通时,有一条最佳实践:把AI当人来沟通。

如果你把AI当系统来沟通,它可能会回答得比较含糊,甚至编造答案。

例如,我问AI,你的训练数据截止到哪一年。

然后Claude否定了自己的身份,并“王顾左右而言他”的回复了一系列内容。

同时,还弹出了系统提示,“别问关于它自己的内容,它可能会编内容(hallucinate)”。

【2】AI目前还不太擅长数学

AI比较擅长知识类问题,以及内容生成类问题,数学问题似乎有点为难它。

例如,我问了一个很简单的鸡兔同笼问题:

AI确实列出了方程:

x+y=2

2x+4y=6

但它却解错了,同时也弹出了系统提示,“AI不擅长解数学问题”。

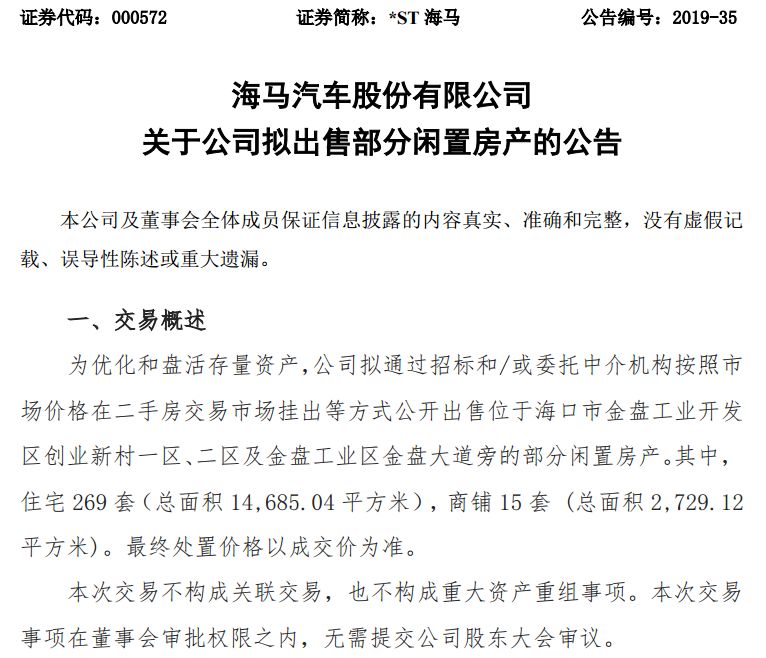

【3】基于历史数据训练的AI不了解当下的事情

效果好,智能高的AI,需要大量数据,长时间训练,因此很多AI是不了解当下的事情的。

接入实时数据的AI,仅在知识问答与搜索的场景里表现较好。

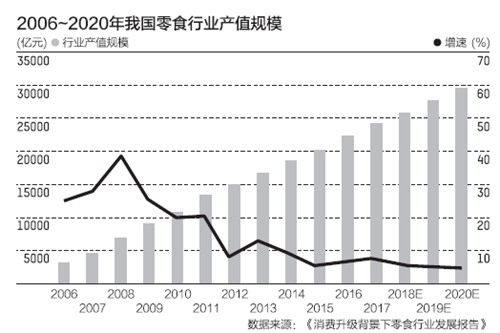

画外音:可以看出,AI是基于20年数据训练的。

【4】AI有可能胡说八道的编内容

有时候,AI不知道提问是知识问答,为了完成回答,他可能“编纂内容”“创作内容”来进行糊弄。

例如,希望它对诗句:

它却在瞎编。

当然,优化提示词之后,AI搞清楚了你的意图,能够得到正确答案。

画外音:此例中的提示词技巧是“举例”。

再举一个更离谱的例子,张飞是如何投奔东吴的?

AI煞有介事的生成了一段内容,什么“曹操派吕蒙攻打荆州”“东吴大将东方朔”“袁术用封赏吸引张飞”…

乍一看,居然有理有据,有宏观,有细节,但是>>>

真离了个大谱。

如何判断AI生成内容的真实性,可靠性,要成为我们即将面对的新难题。

你还见过AI哪些离谱的回答?

相关文章:

《我认为,最好用的AI工具是它》

《最强提示词技巧“喂饭机制”,没有之一》

关键词: